2025.08.27

2025.08.27 5810

5810

人工智能控制矩阵(AI Control Matrix,AICM)是由云安全联盟(CSA)开发的首个针对生成式人工智能现实风险的框架,具有行业迫切需要的精确性和清晰性。AICM不仅仅是一套原则,它提供了一个全面、可操作的框架,用于确保生成型AI系统的安全性——从模型提供商到基础设施运营商、协调服务平台和应用开发者。

AICM不仅能够识别人工智能存在的各类风险,还为其治理设计了一套清晰的实施路线图。该框架填补了宏观伦理指导与具体实践之间的空白,助力人工智能价值链中的所有利益相关方明确自身角色与责任,并降低风险,

AICM工具包在CSA开发的云控制矩阵(Cloud Control Matrix,CCM)的基础上,从治理和技术角度评估生成式人工智能在算力基础设施、网络、计算、存储、应用、数据等端到端的安全。

AICM包含18个领域243个控制项,其专为生成式人工智能定制。AICM遵循责任共担的原则,对所有利益相关方(如通用人工智能基础设施运营商、模型提供商、编排服务提供商、应用程序提供商)所承担的责任进行分解。

AICM内置对ISO/IEC 42001、NIST AI RMF 1.0和BSI AI C4等人工智能主要标准的支持,满足人工智能治理&风险管理&合规(GRC)多框架合规的要求,并实现可审计的准备。通过AICM的人工智能共识倡议自评估问卷(AI-CAIQ :AI Consensus Assessments Initiative Questionnaire),可用于验证人工智能治理和技术的准备情况、展示责任并加速合规。

AICM包含了治理&风险管理&合规、审计与鉴证、应用程序和接口安全、业务连续性管理和运营韧性、变更控制与配置管理、密码学&加密&密钥管理、数据中心安全、数据安全和隐私生命周期管理、人力资源、身份与访问控制、互操作性与可移植性、基础设施安全、日志记录和监控、模型安全、安全事件管理&电子数据展示&云取证 、供应链管理&透明度&问责制、威胁与漏洞管理、通用端点管理、通用端点管理等18个领域。

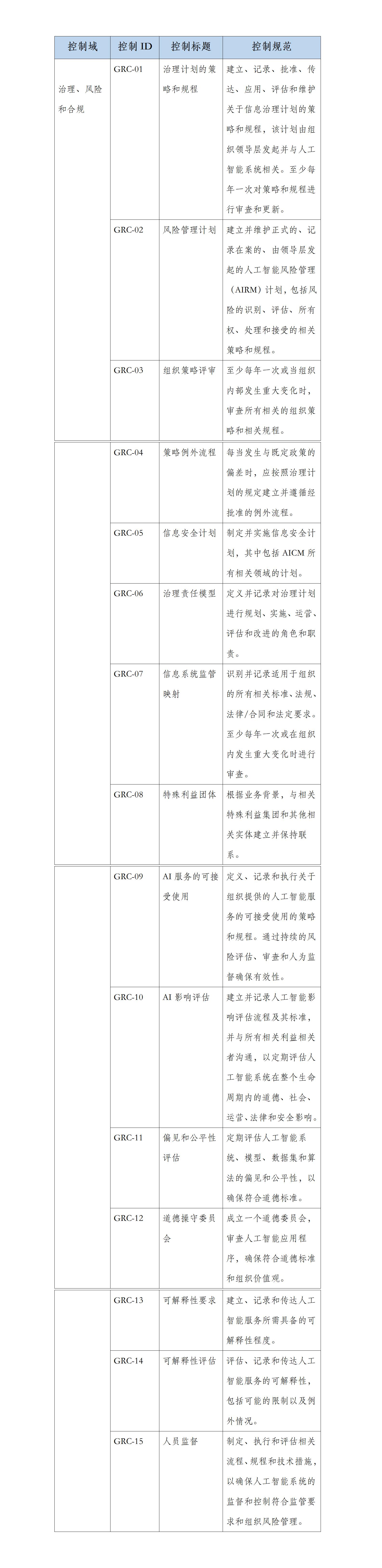

下面我们以AICM的治理&风险管理&合规为例进行展开介绍,治理、风险管理与合规(Governance, Risk Management, and Compliance, GRC)控制域,是人工智能治理体系的核心模块之一,旨在通过系统化的管理框架,确保人工智能的安全策略与业务目标一致,同时满足法律、监管及行业标准要求。以下从定义和核心目标、控制要点、行业价值等多维度展开分析:

一、定义与核心目标

GRC控制领域整合了治理(Governance)、风险管理(Risk Management)和合规(Compliance)三大维度,其核心目标包括:

1. 建立透明化决策机制:明确人工智能治理中各角色的安全责任(如通用人工智能基础设施运营商与模型提供商的安全边界),确保安全策略与业务目标对齐。

2.动态识别与评估风险:通过持续监控人工智能系统中的威胁(如模型操纵、数据投毒、模型窃取、模型服务故障),量化风险影响,并制定优先级响应策略。

3.满足多法规与标准要求:映射至ISO/IEC 42001、NIST AI RMF 1.0和BSI AI C4等国际框架,简化企业跨合规体系的实施成本。

二、关键控制要点

1.治理框架设

策略制定:建立、记录、批准、传达、应用、评估和维护关于人工智能治理计划的策略和规程,该计划由组织领导层发起并与人工智能系统相关。至少每年一次对策略和规程进行审查和更新。

组织架构:设立跨部门的道德遵从委员会,确保技术、法务、业务团队协同,审查人工智能应用程序,确保符合道德标准和组织价值观。

人员监督:制定、执行和评估相关流程、规程和技术措施,以确保人工智能系统的控制符合监管要求和组织风险管理。

2. 风险评估与管理

AI影响评估:建立并记录人工智能影响评估流程及其标准,并与所有相关利益相关者沟通,以定期评估人工智能系统在整个生命周期内的道德、社会、运营、法律和安全影响。

公平性评估:定期评估人工智能系统、模型、数据集和算法的偏见和公平性,以确保符合道德标准。

可解释性评估:评估、记录和传达人工智能服务的可解释性,包括可能的限制以及例外情况。

3.合规性保障

法规映射:将AICM控制项与ISO/IEC 42001、NIST AI RMF 1.0和BSI AI C4等合规要求对应。

审计支持:提供标准化审计问卷(如AI-CAIQ)和认证路径(如AI-STAR认证),公开披露安全状态。

持续改进:通过差距分析识别合规短板,制定改进计划并跟踪闭环。

下表给出了 AICM V1.0对生成式 AI 在治理、风险和合规控制域的示例。

致谢

《人工智能控制矩阵AICM V1.0》(中文版)由云安全联盟大中华区专家翻译,感谢以下专家的贡献

项目组组长:张 淼

组员:陈荣华、苏泰泉、于继万、赵晨曦、江均勇、刘洪森、江澎、吴满、李安伦、邢海韬

本文作者:Zhang Miao(张淼),云安全联盟大中华区专家

登录

登录

雷池WAF

雷池WAF 安恒信息

安恒信息